AI活用

AI活用 1-bitモデルは実用的か?Bonsai 8B vs Gemma 4 E2B をRAG連携で徹底比較

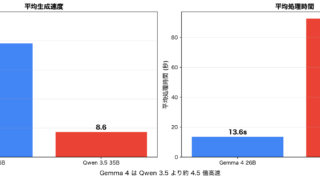

超軽量1.28GBの1-bit量子化モデル「Bonsai 8B」と、3.37GBの4-bit量子化「Gemma 4 E2B」をRAG連携タスクで比較検証。iOSやApple Siliconでのローカル推論を想定し、知識系Q&A・RAGソース活用・回答の具体性を評価。結論として、1-bitモデルは技術デモとしては興味深いが、実用にはサイズ差2.6倍でも4-bitモデルが圧勝。